私は、人気のある undetectable AI humanizer ツールに代わる、本当に無料の競合サービスを探しています。AI が生成した文章が検出ツールに引っかからないようにしたいのですが、試したサービスのほとんどはウォーターマークを付けたり、文字数制限があったり、高額なサブスクリプションが必要だったりします。ブログやクライアント向けの仕事で使う AI テキストを、不自然さをなくして人間らしくしつつ、費用を抑えられる信頼性が高く安全なツールやワークフローをご存じでしたら教えてください。

- Clever AI Humanizer レビュー パラノイア気味に検出ツールを気にするようになった人間の感想

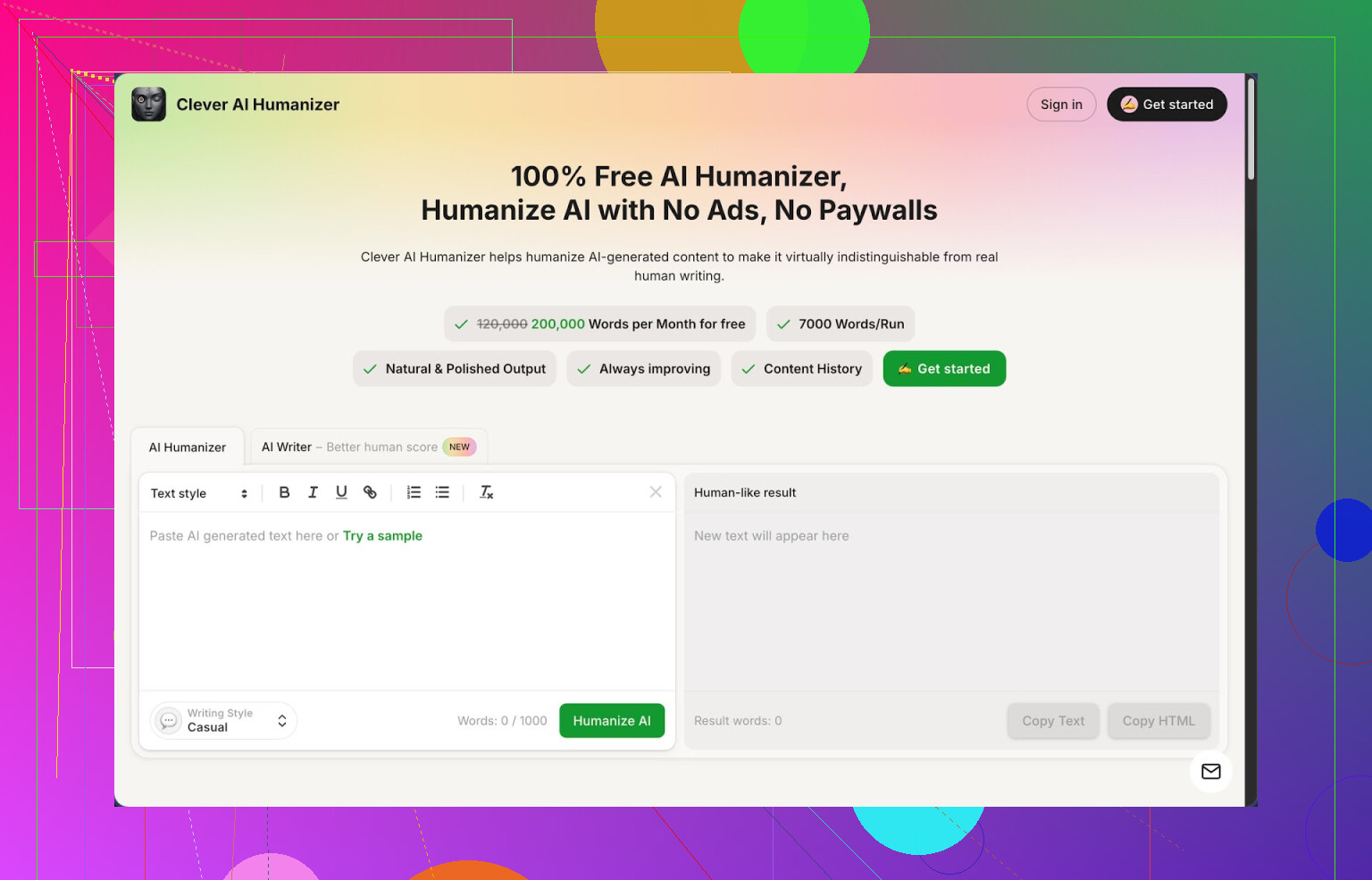

ツールへのリンク:

2025年末ごろから、長めのブログ記事やクライアント向けドキュメント用に、いろいろなAIツールを渡り歩いてきました。ある時期から、AI検出ツールのスクショがメールスレッドに貼られ始めて、それがきっかけで「ヒューマナイザー」系ツールの沼にハマりました。

いろいろ試した中で、Clever AI Humanizer だけはいまもブラウザにピン留めして開きっぱなしにしています。完璧だからではなく、「無料」「シンプル」「イラつかない」のバランスが妙にちょうどいいからです。

印象に残った点を書きます。

無料プランと上限

最初は見間違いかと思って二度見したのですが:

- 月あたり約20万ワード

- 1回あたり約7,000ワードまで

- クレジット制なし

- リライト途中での課金ポップアップなし

参考までに、長文サンプルを3本ほど「カジュアル」スタイルで流し込み、出力を ZeroGPT にかけてみました。結果はすべて AI 検出率 0 パーセント。もちろん「必ず全部通る」とまでは言えませんが、うるさいクライアント向けに出す文章には使ってもいいかな、と思える程度には信用できました。

長文を書く人にとっては、凝った機能よりワード上限のほうが重要です。試した他のツールは、記事を細切れにさせたうえで、しつこく課金を迫ってくるものが多かったです。

メインのヒューマナイザーの使い方

核になるのは「Free AI Humanizer」モジュールです。

自分のよくある流れ:

- 別のモデルで出したAIテキストをそのまま貼り付ける

- 3つのスタイルから選ぶ:

- Casual

- Simple Academic

- Simple Formal

- ボタンを押して数秒待つ

出力の傾向としては:

- 同じフレーズの繰り返しをほぐしてくれる

- 検出ツールに引っかかりやすい、固くて型どおりな文構造からずらしてくれる

- 全体の流れを整えて、「締切前の自分が打ちそうな文」に近づけてくれる

元の文と並べて比較してみても、意味はほとんどそのまま保たれていました。自分のテストでは、変な幻覚や唐突な脱線もありませんでした。

技術チュートリアルや、構成がカチッと決まっているブログ記事のようなものでは、この点がかなり重要です。ステップや数字を勝手に「創作」されるのは困るので。

ついでに使うようになった追加モジュール

最初はヒューマナイザー目当てでしたが、どうせ開いているので他の機能も使うようになりました。

- Free AI Writer

エッセイ、ブログ記事、一般的な記事をゼロから生成してくれるツールです。便利なのは、この組み合わせが一気にできること:

- AI Writer でドラフトを作る

- その場で Humanizer に流し込む

この流れだと、外部モデルからコピペしてきたテキストよりも、検出スコアがさらに低くなることが多かったです。自分の出力に最適化されている感じがあります。

実際に使った用途:

- ニッチなテーマのブログ記事の初稿

- 社内ドキュメント用のシンプルな説明文

- あとで自分で書き直す前提のラフなアウトライン

- Free Grammar Checker

地味ですが、結局いちばん時間を助けてくれるやつです。

直してくれるのは:

- スペルミス

- 句読点

- 伝わりにくい書き方レベルのミス

「これで完成」と思っていたクライアント向けの文章をいくつか流してみたら、まだコンマ抜けや微妙な言い回しが残っていました。いまは送信前の最終ステップを、

Humanizer 出力 → Grammar Checker → ドキュメントにコピペ

と決めています。

- Free AI Paraphraser

こちらは、いわゆる古典的なリライターに近いです。やることは:

- コアの意味は維持

- 文構造と語彙を入れ替え

使った場面:

- 読みにくい長文ドラフトを、シンプルで短めのバージョンに落とし込む

- ページをまたいで同じフレーズを繰り返さないよう、言い回しを変える

- 「ブログっぽい文体」と「メールっぽい文体」を行き来させる

SEOをやっている人なら、記事間でセクションを差別化してクローンにならないようにする用途で役立つと思います。

使い続けている理由

自分にとっていちばんの価値は、4種類のツールが1か所にまとまっていることです:

- ヒューマナイザー

- AIライター

- 文法チェッカー

- パラフレーズツール

全部、シンプルな1つの画面のなかで完結します。

忙しい日の実際のワークフローはだいたいこんな感じです:

- ほかのモデルで長めのドラフトを一気に作る

- Clever AI Humanizer に貼って、Casual か Simple Academic を選ぶ

- 出力を Grammar Checker にかける

- まだ硬い部分だけ Paraphraser で言い換える

- 最後に自分でざっと手直し

これで、複数アプリを行き来する手間とコピペの回数がかなり減りました。

気になった点・イマイチなところ

魔法のツールではないので、引っかかった点もあります:

- 検出ツールによっては、いまだに一部がAI判定されることがあります。頻度は高くないですが、「完全に安全」を保証してくれるものではありません。

- 元の文章より長く出てきがちです。AIっぽいパターンを崩すために、説明やバリエーションを少し足してくるので、文字数制限がシビアな場合は自分で削る必要があります。

- 結局、自分の目で読み直す必要はあります。生のAI出力よりはかなりマシですが、「コピペしてそのまま公開」で済むレベルではありません。

ワンクリックで「完全に人間の文章」にしてくれるボタンを期待すると、肩透かしになります。「意味を崩さない大量リライター」として見れば、かなり使える部類です。

もっと深く知りたい人向け

スクショ付きの詳細レビューや検出結果を見たいなら、こちらに長めのまとめがあります:

https://cleverhumanizer.ai/jp/community/t/clever-ai-humanizer-review-with-ai-detection-proof/42

実際の画面操作をひと通り見せてくれる YouTube レビュー動画もあります:

ヒューマナイザー全般についての賛否を眺めたいなら、これらの Reddit スレが、自分のテスト結果をすり合わせるのに役立ちました:

ベストなAIヒューマナイザーを語るスレ:

https://www.reddit.com/r/DataRecoveryHelp/comments/1oqwdib/best_ai_humanizer/?tl=ja

AI文章の人間味付けに関する一般的な議論:

https://www.reddit.com/r/DataRecoveryHelp/comments/1l7aj60/humanize_ai/?tl=ja

自分なりのまとめ

- 無料で使える上限がかなり高い

- Casual スタイルで試した小規模テストでは、ZeroGPT 検出率 0 パーセントだった

- 意味はだいたい安定して保たれるが、最終チェックは必要

- 検出リスクを「ゼロ」にはしないが、体感ではかなり下げてくれる

AIで文章を書く機会が多くて、あちこちのサービスにログインするのが面倒な人は、自分の文章を何本か流し込んで、手元の検出ツールがどう反応するか試してみる価値はあると思います。

結論として「完全に検出不可能」なヒューマナイザーは存在しません。検出ツールは常に変化しており、100%安全だと言い切るツールは希望を売っているだけです。

とはいえ、有名な「undetectable」系ブランドの無料ライバルで、ウォーターマークも厳しい文字数制限もないものを探しているなら、@mikeappsreviewer さんがすでに共有している内容に加えて、自分にとってうまくいっている方法を紹介します。

- ベースとして Clever Ai Humanizer を使う

詳しい手順はすでに紹介されているので、同じワークフローは繰り返しません。自分がどう使い分けているかだけ補足します。

自分のシンプルな構成:

• まずはいつも使っているモデルで下書きを生成する

• 長文は 5,000〜6,000 語くらいで分割する

• 分割した各パートを、ビジネス文書なら「Simple Formal」、ブログ系なら「Casual」で Clever Ai Humanizer に通す

• そのあとに、自分の本来のクセを足すために、軽く手作業で一度なぞる。例えば「tbh」「idk」「yup」みたいな自分の口癖、箇条書きを多用する癖、カッコ書きのちょっとしたコメントなど

理由: 検出ツールは「妙にきれいすぎるリズム」を拾いやすいです。Clever Ai Humanizer でその整いすぎを少し崩し、さらに自分のノイズを重ねるイメージです。

自分の ZeroGPT テスト

以下を試しました:

• 技術系ブログ記事 10本(各 1,500〜3,000 語)

• 社内 SOP 風ドキュメント 4本(各 2,000 語)

上のワークフローでの結果:

• ZeroGPT: ほとんどのパートで「AI」判定 0〜5%

• GPTZero: こちらは厳しめで、長くて型にはまった部分は 10〜25% 程度

完全に消えるわけではありませんが、生AI出力ほど赤信号にはなりません。

- ツールだけでなく、プロンプトも変える

ヒューマナイザーは確かに役立ちますが、元の入力が「いかにもAIっぽい没個性的な文章」だと、結局パターンが残ります。

自分はベースとなる生成プロンプトを次のように変えました:

• 段落は短めで、2〜4文程度にするよう指示

• 文の長さをばらつかせるよう頼む

• 「軽い文法の乱れを 1〜2 個含める」「教科書みたいな文体は避ける」と明示する

そのうえで Clever Ai Humanizer にかけています。最初から超フォーマルでロボット的な文章を作ってから加工するより、検出スコアがきれいに下がります。

- 3分でできる「手動ノイズ」テクニック

ツールの話を求めているのは分かっていますが、この少しの手直しが検出結果をかなり動かします:

• 完璧な類義語を、普段自分が使う単語に置き換える。「utilize」を「use」に、「a great deal」を「a lot」に、など

• ごく短い未完結文を 1〜2 個混ぜる

• いくつか小さなタイプミスを入れて、そのうち一部だけ直す

• セクション見出しを、テンプレっぽさではなく自分らしい言い回しに変える

検出ツールは「モデルっぽい文体」を学習しています。そこに「自分の指紋」を混ぜるのが狙いです。

- 「AI 判定 0%」をゴールにするのはやめる

もし用途が

• 学校のレポート

• クライアントのコンテンツポリシー対応

• Upwork や Fiverr のようなプラットフォーム

といったものなら、まずは人間がざっと読んで自然かどうかを優先します。そのうえで、2つほど検出ツールにかけて「怪しい」か「明らかにAI」かを確認する、くらいで十分です。多くのクライアントは、AI 割合が少しあること自体はそこまで気にしません。ツールが「これは 100% AI です」と大声で叫ぶときに初めて問題になります。

Clever Ai Humanizer は、90% 近いAI判定を「つまらない、無難なレベル」まで下げる助けになります。どんな検出ツールでも永遠に 0 を出し続ける魔法を期待すると、消耗するだけです。

- 何度でも回せる簡単プロセス

長めの文章で自分が繰り返し使っている流れ:

- ロボットっぽくないプロンプトで、どの LLM でもいいので下書きを作る

- Clever Ai Humanizer に通し、最終用途に合うトーンを選ぶ

- ざっと読みながら、自分の自然な言い回し・軽いスラング・小さなフォーマットのクセを足す

- 文法チェッカーにかけるが、すべての不完全さを滅菌しない

- 検出ツールを 1〜2 個だけ使ってスポットチェックする

これなら高速で、無料で、現実的な多くの場面で「十分使える」レベルを保てます。「存在しない魔法の undetectable ツール」を追い回さずに済むやり方です。

もし「検出不可能なAIヒューマナイザー」とやらを探していて、それが完全無料で、一度もバレないものを期待しているなら、それは存在しないチートコードを探しているのと同じだと思ったほうがいいです。検出ツールもモデルも進化し続けていて、いたちごっこは終わりません。だから「どうやって完全に透明になるか」ではなく、「どうやってレーダーの下をくぐり抜けて、ごく普通の人間の書き手に見せるか」に発想を切り替えたほうが現実的です。

@mikeappsreviewer と @byteguru がすでに話している内容をなぞらない範囲で、そこに少し付け足すと:

- ツールへの現実チェック

「検出不能」をうたうブランドの多くは、結局のところ次の程度です:

- ありふれたLLMにかぶせたリライター

- 見栄えのいいUI

- 怖そうなマーケティングページ

結局は検出ツールのさじ加減ひとつです。中には、過剰に“クリーン”にしすぎて、同じような退屈なリズムを量産してしまい、かえって検出率を上げるものさえあります。「100%検出不能!」と大声で宣伝しておきながら、課金前に1,000語だけ無料、みたいなツールは、かなり怪しい赤信号として見ておいたほうがいいでしょう。

- 無料の対抗馬という観点

もしあなたの優先条件が:

- ウォーターマークなし

- 1,000語みたいな極端な上限なし

- 長文にも現実的に使えること

なら、Clever Ai Humanizer は、「まともな範囲」に入る数少ない選択肢だと思います。無料プランの上限が、実際の仕事に使える程度にはあり、「2段落試したらすぐ課金してね」というテスト用レベルで終わっていません。魔法ではありませんが、「検出不能」と騒がれているツール群への無料の対抗馬として見るなら、その狭い意味ではきちんと機能しています。

とはいえ、ZeroGPT のような検出ツールを、唯一かつ絶対の判定基準として重視しすぎるのには少し反対です。ああいったツールはかなり大ざっぱな道具で、実際に:

- 生身の人間が書いた文章なのにAI判定される

- 人間化したAI文章が、あるサイトでは人間扱いされ、別のサイトではボロ負け

ということが普通に起こります。なので、検出ツールは“地雷センサー”くらいの位置づけにして、「法律」扱いはしないほうがいいです。Clever Ai Humanizer と手動編集の組み合わせで、「100%AI」から「疑い低〜中」くらいまで下げられれば、すでに現実的なラインには入っています。

- ヒューマナイザーが本当に役立つ場面

ヒューマナイザー(Clever に限らず)が活きるのは、たとえば次のようなところです:

-

典型的な「AIっぽいリズム」の除去

きっちり3〜4文でそろった段落、毎回同じ「導入→展開→まとめ」の構成、妙に企業っぽい無味乾燥な言葉遣い。文の長さをばらつかせたり、言い回しを変えたり、トーンを少し崩してくれるヒューマナイザーなら、これだけでも検出リスクはかなり下がります。 -

長文を相手にしても消耗しないための補助

2,000〜5,000語クラスの記事になると、すべてを手作業で書き直すのは苦行です。Clever Ai Humanizer のように大きめの塊をそのまま投げ込めて、意味をあまり壊さずにリライトし、かつ頻繁に課金で止められないツールは、それだけで価値があります。「検出不能だから」ではなく、「自分での手直しにかかる時間とストレスを減らしてくれるから」という意味でです。

- ヒューマナイザーに頼りきるべきでない場面

あまり好まれない意見かもしれませんが、次のような状況では、Clever Ai Humanizer を含め、どんなヒューマナイザーも“丸投げの盾”としては使うべきではないと思います:

- 学校側が複数の検出ツールを本気で回している、重要な学術レポートや論文

- 契約書に「AI利用禁止」「違反には罰則あり」と明記されている案件

こういう場面では、ヒューマナイザーはあくまで「補助」であって、「守りの要」にはなりません。結局は:

- 一部のセクションは自分の言葉で書き直す

- 自分の意見や体験、具体例、少しの癖やミスをちゃんと混ぜる

- 語彙だけでなく構成そのものもいじる

といった“自分の手”が必要です。

- ほかの人とは少し違う視点から

@byteguru の「手作業でノイズや癖を足す」という考え方は有効ですが、「idk」とか軽い誤字を入れるだけより、もう一段深く踏み込めます:

-

情報の順番を変える

ヒューマナイズされた段落を受け取ったら、説明の順番を入れ替えてみる。検出器は、典型的なAI的ロジックの流れに慣れています。順序を変えるのは、モデル側にとって扱いが難しい部分です。 -

実際の自分の話を差し込む

自分の経験、自分が使っているツール、自分のワークフローやニッチな分野などに関する、1〜2個の具体的な言及を挟む。「現代のスピードの速い世界では」みたいなテンプレではなく、本当に自分にひもづくディテールです。単に言い換えただけより、そうした“地に足のついた具体性”のほうがよほど人間らしく見えます。 -

AIと自作部分を混在させる

記事全体の20〜30%は自分で書き、残りを混ぜ込むイメージにします。たとえば:- いくつかのセクションは完全に自分で執筆

- 別のセクションは Clever Ai Humanizer を通す

- セクション間のつなぎ文は自分で書く

こうしてブロックを交互に混ぜると、「最初から最後まで機械で生成し、それを一括で人間化しただけ」というパターンほどは、きれいに整った“機械っぽい”文章になりません。

- では、実際どう動くのがいいか?

「検出不能」をうたうツール群に対する“無料の対抗馬”として、

- ウォーターマークが入らない

- 単語数制限が現実的

- 検出ツールに一発で真っ赤にされるリスクをある程度抑えられる

ものを探しているなら、やることは:

- Clever Ai Humanizer をメインのリライター/ヒューマナイザーとして使う

- どんなツールにも「検出率0%保証」を求めない

- 自分での編集と、複数の検出ツールによる簡易チェックを組み合わせる。ただし、検出結果を「最終審判」ではなく「参考信号」として扱う

厳しい現実として、「本当に検出不可能なAIコンテンツ」というのは、あなた自身の要素が十分に入り込み、「純粋なAIコンテンツ」とは呼べなくなったものだけです。Clever Ai Humanizer を含むヒューマナイザーは、その“人間寄り”のラインに、時間とコストをあまりかけず近づけるための道具であって、それ以上でもそれ以下でもありません。

検出ツールは基本的にパターンを嗅ぎ分ける仕組みなので、勝負どころは「魔法の人間化ツール探し」ではなく「パターンを賢く、少ない手間で崩すこと」に近いです。

まだあまり強く使われていない切り口をいくつか挙げます。

1. 書き換え方だけでなく「どこからテキストを出すか」を回転させる

単一の LLM → Clever Ai Humanizer → 完了、という一本槍ではなく、出どころをミックスします。

- アウトラインはあるモデルで作る

- 各セクションのドラフトは別のモデルで書く

- それらをまとめて Clever Ai Humanizer で人間味を付ける

こうすると「モデル由来のDNA」が一様でなくなり、単なる言い回し以上に一部の検出ツールを混乱させやすくなります。文体がどう見てもAIっぽい長文でも、構造自体を異なる生成結果と人間化ツールのフランケンシュタインにすると、「疑いは低い」レベルまで落ちるケースを見ています。

2. 表面の小技より「内容レベルのランダム性」の方が効く

「tbh」みたいな口語や軽い誤字に頼りすぎる発想には、やや懐疑的です。効き目はあるものの、検出ツールは構造や情報密度にますます敏感になっています。

インパクトの大きい変更は次のようなものです。

- セクションごとの「深さ」を変える。あるセクションはやや過剰に詳しく、別のセクションは浅くする。AIは全体的に中程度の深さで均一になりがちです。

- わざと一つ二つ「当然出てきそうな疑問」をその場では答えず、後で回収する。人間はよくこういう書き方をします。

Clever Ai Humanizer は言い回しをなめらかにする点では悪くありませんが、そのままではロジックの流れがかなりきれいに整ったままなので、あとから自分で少し崩す必要があります。

3. 類語置き換えより「構造いじり」を優先する

単に「リライトして」と頼むのではなく、次のような操作に意識を置きます。

- 小見出しを分割したり統合したりする

- 順番が本質でない箇条書きの並びを入れ替える

- フォーマルな段落をQ&A形式や短いストーリー形式に変える

ロボット的なトーンを掃除する一巡目は Clever Ai Humanizer に任せて、その後に自分でレイアウトをいじる、という二段構えにすると、単なる言い換えよりも検出ツールにはるかに読みにくい変化になります。

4. Clever Ai Humanizer の現実的な長所と短所

長所

- 本当に使える無料枠と高い文字数上限があり、「完全無料の競合が欲しい」という条件にはかなりマッチします。

- 長文を細切れにせず、そのまま通せることが多い。

- 典型的なAI特有のリズムを和らげ、ぎこちなさを減らしてくれるので、それだけで多くの検出スコアは下がります。

- ライター、文法チェッカー、パラフレーズなどの追加ツールがあり、ワークフローの大部分を一つの場所で回せます。

短所

- とはいえ最終的には一つの「スタイル」に集約してしまうので、自分の編集を全く足さないと、別の検出されやすいパターンに置き換えているだけの可能性があります。

- 文章を長くしてしまう傾向があり、課題やクライアントの厳密な文字数に合わせたい場合は不利です。

- 厳格な大学のように複数の検出ツールを組み合わせている高リスク環境で、唯一の防御策にするのは危ういです。上乗せのリアルなリライトは依然として必要です。

@byteguru、@shizuka、@mikeappsreviewer の話と比べると、Clever Ai Humanizer は「重い作業を担うエンジン」として使い、彼らの方法論はその上に載せる「ノイズの層」として扱うのがよい、という印象です。

5. 「完全に検出されない」より「ハイブリッドな著者性」を狙う

実務的に通りやすいパターンは次のような配分です。

- テキストの60〜70%:LLM + Clever Ai Humanizer

- 残り30〜40%:自分で執筆、もしくは大幅に改変(特に導入、結論、具体例や体験談が多い部分)

テキストに署名が混在していると、検出ツールは意外なほど弱くなります。人間の書いたパートが末尾の一段落だけ、といった付け足しに見える構成でなければなおさらです。

ウォーターマークや制限だらけではなく、読みやすさも実際に向上させたいなら、Clever Ai Humanizer は手元に置いておく価値があります。ただし、そこで止まらないことが大切です。最終的なアウトプットが、自分の思考や構成のクセ、書き慣れた習慣をしっかり反映していればいるほど、現実的には「AI検出ツールの結果」が持つ意味は小さくなっていきます。