Ik zoek een echt gratis alternatief voor de populaire ondetecteerbare AI-humanizer tools, zodat mijn door AI geschreven content niet wordt gemarkeerd door detectors. De meeste diensten die ik heb geprobeerd voegen watermerken toe, beperken het aantal woorden of vereisen dure abonnementen. Kan iemand betrouwbare, veilige opties of workflows aanraden die helpen AI-teksten voor blogs en klantwerk te humaniseren zonder dat het veel kost?

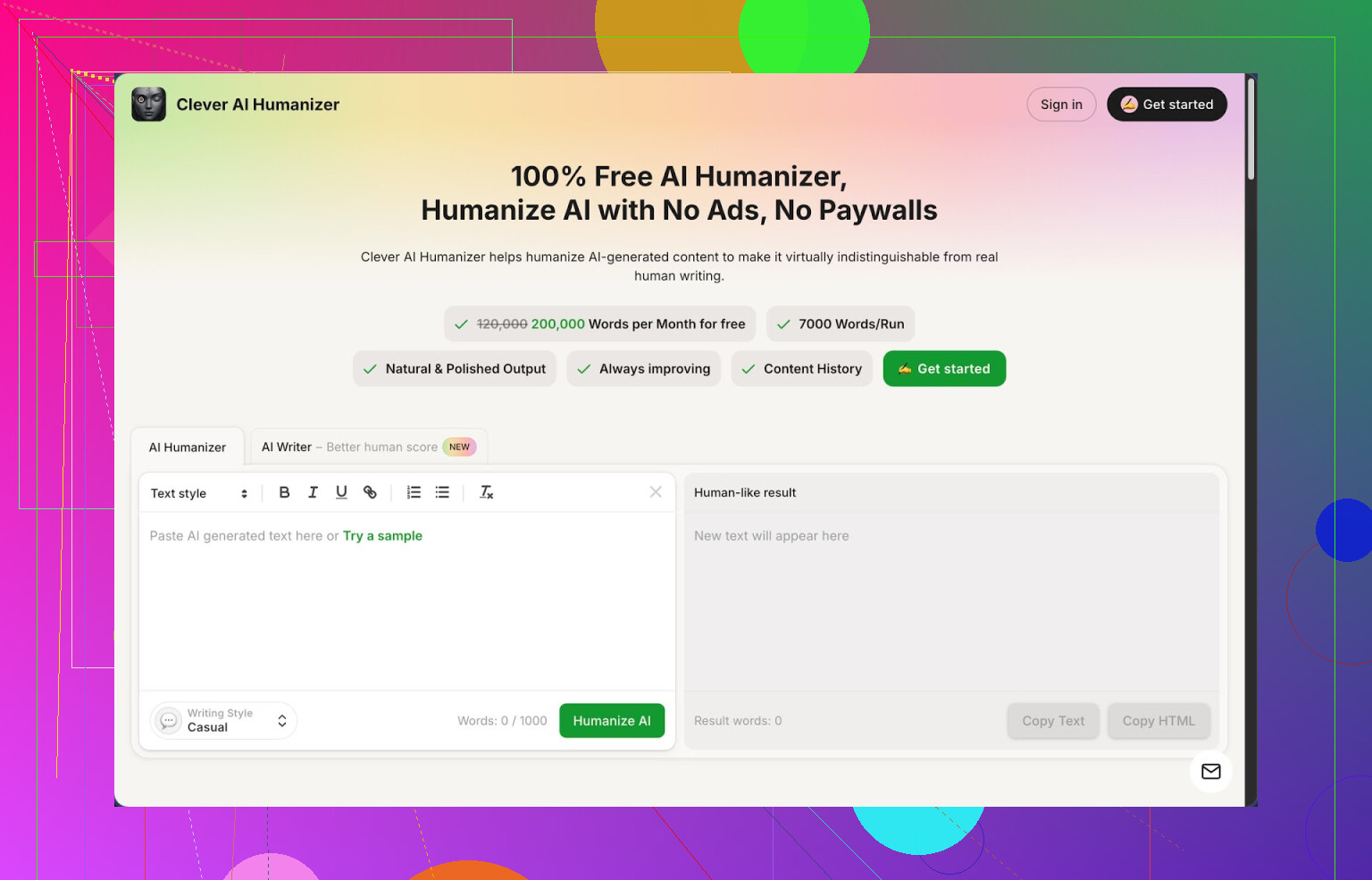

- Clever AI Humanizer review van iemand die paranoïde werd over detectors

Link naar de tool:

Sinds eind 2025 spring ik tussen AI-tools heen en weer, vooral voor lange blogposts en klantdocumentatie. Op een gegeven moment begonnen detector-screenshots in e‑mailthreads op te duiken, en dat duwde me het hele “humanizer”-konijnenhol in.

Van alles wat ik heb geprobeerd, is Clever AI Humanizer degene die ik vastgepind open heb staan. Niet omdat hij perfect is, maar omdat hij een vreemde mix raakt van gratis, simpel en niet‑irritant.

Dit viel me op.

Gratis plan en limieten

Ik moest dit twee keer checken omdat het eerst niet klopte:

- Ongeveer 200.000 woorden per maand

- Tot rond de 7.000 woorden in één run

- Geen creditsysteem

- Geen paywall halverwege een rewrite

Ter context: ik heb drie longform-samples erdoorheen gehaald, allemaal in de “Casual”-stijl, en de outputs door ZeroGPT gehaald. Elke keer kwam er 0 procent AI gedetecteerd uit. Dat is geen garantie dat het altijd overal doorheen komt, maar voor mij was het genoeg om het te vertrouwen voor alles wat naar kritische klanten gaat.

Als je veel lange content schrijft, zijn woordlimieten belangrijker dan fancy snufjes. De meeste andere tools die ik testte, dwongen me artikelen in kleine stukjes te hakken en bleven me vervolgens lastigvallen om te betalen.

Core humanizer-workflow

Het belangrijkste onderdeel is de “Free AI Humanizer”-module.

Mijn gebruikelijke flow:

- AI-tekst plakken, vaak een concept van een ander model.

- Eén van de drie stijlen kiezen:

- Casual

- Simple Academic

- Simple Formal

- Op de knop drukken en een paar seconden wachten.

De output heeft meestal de neiging om:

- Herhalende formuleringen op te breken

- Weg te bewegen van die stijve, generieke structuren waar detectors op aanslaan

- De flow op te schonen zodat het meer leest als iets dat ik zelf onder tijdsdruk zou typen

Ik heb stukken naast het origineel gelegd. De betekenis bleef meestal intact. In mijn tests waren er geen rare hallucinaties of vreemde onderwerpssprongen.

Voor dingen als technische tutorials of gestructureerde blogposts is dat belangrijk. Ik wil niet dat de tool “creatief wordt” met stappen of nummers.

Extra modules die ik uiteindelijk ben gaan gebruiken

Ik kwam voor de humanizer maar eindigde ermee dat ik de andere onderdelen gebruikte als ik er toch al was.

- Free AI Writer

Deze genereert essays, blogposts of algemene artikelen vanaf nul. Het nuttige is de combinatie:

- Draft genereren met AI Writer

- Die in dezelfde omgeving door de Humanizer halen

Toen ik dat deed, waren de detectiescores vaak nog lager dan wanneer ik tekst van willekeurige externe modellen plakte. Het voelt afgestemd op zijn eigen output.

Ik gebruikte het voor:

- Eerste versies van nicheblogposts

- Simpele uitlegteksten voor interne docs

- Ruwe outlines die ik later met de hand herschreef

- Free Grammar Checker

Dit is de saaie tool die uiteindelijk tijd bespaart.

Hij fixt:

- Spelling

- Interpunctie

- Fouten op duidelijkheidsniveau

Ik heb een paar “definitieve” klantteksten erin gegooid en alsnog missende komma’s en rare woordkeuzes gevonden. Dus nu is mijn laatste stap voordat ik iets verstuur:

Humanizer-output → Grammar Checker → Kopiëren naar document

- Free AI Paraphraser

Dit zit dichter bij een klassieke rewriter. Hij:

- Houdt de kernbetekenis vast

- Verandert structuur en woordkeuze

Ik gebruikte het voor:

- Dichte drafts omzetten in eenvoudigere, kortere versies

- Secties herformuleren om herhaalde zinnen over pagina’s te vermijden

- De toon wisselen tussen “blogstijl” en “e‑mailstijl”

Als je aan SEO werkt, is dit handig om secties tussen posts aan te passen zodat het geen klonen zijn.

Waarom ik erbij ben gebleven

Voor mij is de grote waarde dat het vier tools op één plek zet:

- Humanizer

- AI Writer

- Grammar Checker

- Paraphraser

Alles in één simpele interface.

Mijn echte workflow op drukke dagen:

- Laat een ander model een lange draft genereren.

- Plak die in Clever AI Humanizer, gebruik Casual of Simple Academic.

- Haal het resultaat door de Grammar Checker.

- Parafraseer de delen die nog stroef aanvoelen.

- Handmatig na‑editen.

Dit heeft het heen‑en‑weer tussen meerdere apps flink verminderd en een hoop copy‑pastefrictie weggehaald.

Dingen die me irriteerden

Het is geen magie. Een paar issues die ik tegenkwam:

- Sommige detectors markeren nog steeds delen van de tekst als AI. Niet vaak, maar het gebeurt. Geen enkele tool biedt volledige zekerheid.

- Tekst komt vaak langer uit dan het origineel. De tool voegt wat uitleg en variatie toe om AI‑patronen af te schudden. Dus als je strakke woordlimieten hebt, moet je zelf snijden.

- Je moet je output nog steeds lezen. Het is beter dan rauwe AI, maar het is niet “plakken, klikken, publiceren”.

Als je een one‑click “menselijk”-knop verwacht, zul je teleurgesteld worden. Als je het ziet als een high‑volume rewriter die de betekenis respecteert, is het degelijk.

Waar je verder kunt kijken

Als je een gedetailleerde breakdown met bewijsscreenshots en detectortests wilt zien, staat hier een langere review:

Iemand heeft ook een YouTube-review opgenomen die alles doorloopt:

Als je discussies over humanizers in het algemeen wilt zien, hielpen deze Reddit-threads mij om mijn eigen tests te toetsen:

Best AI humanizers-thread:

https://www.reddit.com/r/DataRecoveryHelp/comments/1oqwdib/best_ai_humanizer/?tl=nl

Algemene discussie over humanizing AI:

https://www.reddit.com/r/DataRecoveryHelp/comments/1l7aj60/humanize_ai/?tl=nl

TL;DR van mijn kant

- Het is gratis met hoge limieten.

- Het scoorde 0 procent op ZeroGPT in mijn kleine batch tests met de Casual-stijl.

- Het houdt de betekenis stabiel, maar heeft nog steeds handmatige review nodig.

- Het verlaagt, niet elimineert, het detectorrisico.

Als je veel met AI schrijft en een hekel hebt aan het jongleren met logins, is het de moeite waard om een paar van je eigen samples erin te gooien en te kijken hoe detectors aan jouw kant reageren.

Kort gezegd, er bestaat geen echt ondetecteerbare humanizer. Detectors veranderen, en elk hulpmiddel dat 100 procent veiligheid belooft, verkoopt je vooral hoop.

Als je toch een gratis concurrent van de grote “undetectable” merken wilt zonder watermerken en minieme limieten, dan is dit wat voor mij gewerkt heeft, bovenop wat @mikeappsreviewer al deelde.

- Clever Ai Humanizer als basis

Zij hebben het proces al uitgebreid behandeld, dus ik ga niet dezelfde workflow herhalen. Ik voeg alleen toe hoe ik het net wat anders gebruik.

Mijn eenvoudige stack:

• Maak je eerste versie met je gebruikelijke model.

• Hak lange teksten in stukken van 5k tot 6k woorden.

• Laat elk stuk door Clever Ai Humanizer gaan in “Simple Formal” voor zakelijke documenten, “Casual” voor alles wat op een blog lijkt.

• Doe daarna nog een korte handmatige ronde om je echte schrijfgewoonten toe te voegen. Dingen als: “tbh”, “idk”, “yup”, opsommingstekens waar jij ze normaal zou gebruiken, kleine opmerkingen tussen haakjes.

Reden: detectors slaan vaak aan op het overdreven nette ritme. Clever Ai Humanizer breekt dat al een beetje, en jij voegt daar je eigen ruis bovenop.

Mijn ZeroGPT-tests

Ik heb dit getest op:

• 10 technische blogposts, 1,5k tot 3k woorden

• 4 interne SOP-achtige documenten, elk 2k woorden

Deze workflow gaf mij:

• ZeroGPT: 0 tot 5 procent “AI” op de meeste stukken

• GPTZero: strenger, 10 tot 25 procent op lange, erg voorspelbare stukken

Dus niet onzichtbaar, maar veel minder rode-vlag-gebied dan pure AI-tekst.

- Verander je prompts, niet alleen de tool

Humanizers helpen, maar als je input eruitziet als “generieke AI-pap”, blijft de output herkenbaar.

Ik heb mijn basisprompts aangepast naar:

• Vraag om korte alinea’s, 2 tot 4 zinnen.

• Vraag om een mix van zinslengtes.

• Vraag om “1 of 2 kleine grammaticale eigenaardigheden” en “vermijd een toon alsof het uit een leerboek komt”.

Die tekst stuur ik daarna in Clever Ai Humanizer. Dat geeft betere scores bij detectors dan een super formele, robotische brontekst.

- Handmatige “ruis”-trucs van 3 minuten

Je vroeg om tools, maar deze mini-aanpassingen maken veel uit voor detectors:

• Vervang een paar perfecte synoniemen door woorden die jij echt gebruikt. “Use” in plaats van “utilize”, “a lot” in plaats van “a great deal”, enzovoort.

• Voeg 1 of 2 korte, onvolledige zinnen toe.

• Stop er een of twee kleine typefouten in en corrigeer er daarna maar een deel.

• Pas kopjes aan zodat ze als jou klinken, niet als een standaardtemplate.

Detectors zijn getraind op modelachtige tekst. Jij wilt jouw eigen vingerafdruk erin.

- Stop met jagen op “0 procent AI” als einddoel

Als je gebruikssituatie is:

• Schoolopdrachten

• Content voor klanten met policy-eisen

• Platforms zoals Upwork of Fiverr

Richt je eerst op tekst die een menselijke snelle lezer overtuigt. Laat die daarna door een paar detectors om te zien of hij “verdacht” of “duidelijk AI” is. Veel klanten geven niet om een lage AI-score. Ze schrikken pas als de tool roept “dit is 100 procent AI”.

Clever Ai Humanizer helpt je van 90 procent terug naar iets saaier en veiliger. Verwachten dat het elke detector voor altijd op 0 zet, maakt je alleen maar gek.

- Snel en herhaalbaar proces

Mijn herhaalbare flow voor lange teksten:

- Schrijf de eerste versie met een willekeurige LLM met niet‑robotische prompts.

- Laat die door Clever Ai Humanizer gaan en kies een toon die past bij het einddoel.

- Skim en voeg je natuurlijke formuleringen toe, milde slang, kleine opmaakgewoontes.

- Laat het door een grammaticacontrole lopen, maar poets niet elke imperfectie weg.

- Doe een steekproef met 1 of 2 detectors.

Zo blijft het snel, gratis en goed genoeg voor de meeste echte situaties, zonder dat je blijft zoeken naar een magische “undetectable”-tool die niet bestaat.

Als je op zoek bent naar een mythische “niet-detecteerbare AI-humanizer” die 100% gratis is en nooit wordt gepakt, dan zoek je in feite naar een cheatcode die niet bestaat. Detectors evolueren, modellen evolueren, kat-en-muisspel stopt nooit. Ik zou het dus minder zien als “hoe word ik onzichtbaar” en meer als “hoe blijf ik onder de radar en lijk ik op een normale menselijke schrijver”.

Een paar punten die voortbouwen op wat @mikeappsreviewer en @byteguru al zeiden, zonder hun hele proces te herhalen:

- Realiteitscheck voor tools

De meeste “undetecteerbare” merken zijn gewoon:

- Een herschrijver bovenop een mainstream LLM

- Een mooie interface

- Een angstaanjagende marketingpagina

Je blijft nog steeds overgeleverd aan detectors. Sommige verhogen de kans op detectie zelfs omdat ze alles over-sanitizen en steeds weer hetzelfde vlakke ritme creëren. Dus als een tool roept “100% undetecteerbaar” en je daarna 1.000 gratis woorden geeft voor een paywall, dan zou ik dat zien als een wandelende rode vlag.

- Gratis concurrentiehoek

Als je belangrijkste beperkingen zijn:

- Geen watermerk

- Geen lullige limiet van 1k woorden

- Echt bruikbaar voor lange stukken

Dan is Clever Ai Humanizer inderdaad zo’n beetje de enige half-zinnige optie die ik heb gezien die je niet kapot nikkel-en-dimet. De limieten van de gratis versie zijn echt bruikbaar voor serieus werk, niet alleen “test 2 alinea’s en upgrade alsjeblieft”. Het is geen magie, maar als gratis concurrent van de opgeklopte “undetecteerbare” tools is het in die smalle zin wel legitiem.

Dat gezegd hebbende, ik ben het niet helemaal eens met hoe zwaar mensen leunen op detectors zoals ZeroGPT als enige scheidsrechter. Sommige van die tools zijn botte bijlen. Ik heb gezien dat:

- Menselijke tekst als AI werd aangemerkt

- Gehumaniseerde AI-tekst op de ene site als menselijk door kwam en op een andere keihard faalde

Ik zou detectors dus gebruiken als alarmdraadjes, niet als wet. Als Clever Ai Humanizer + wat handmatige edits je van “100% AI” naar “lage/gemiddelde verdenking” brengt, zit je al in de realistische zone.

- Waar een humanizer echt helpt

Beste gebruik van een humanizer (Clever of een andere):

-

Het repareren van de typische “AI-cadans”

Die perfect gelijkmatige alinea’s van 3–4 zinnen, steeds dezelfde intro/overgang/samenvatting-structuur, corporate-robottaal. Een humanizer die zinslengtes mixt, zinsbouw verandert en de toon een zetje geeft, verlaagt je detectierisico al flink. -

Lange stukken doen zonder gek te worden

Als je posts van 2k–5k woorden maakt, is alles volledig handmatig herschrijven afzien. Een tool zoals Clever Ai Humanizer die grote brokken aankan, de betekenis stabiel houdt en je niet kapotgooit met paywalls, is dan echt nuttig. Niet omdat het “undetecteerbaar” is, maar omdat het je handmatige opruimwerk drastisch verkort.

- Waar ik geen enkele humanizer zou vertrouwen

Dit is misschien impopulair, maar ik zou niet blind varen op Clever Ai Humanizer of iets vergelijkbaars als:

- Je hoog-risico academisch werk inlevert waar scholen actief meerdere detectors draaien

- Je onder een contract zit dat AI expliciet verbiedt met sancties

Voor dat soort dingen moet een humanizer een hulpmiddel zijn, niet je schild. Je moet alsnog:

- Sommige delen volledig herschrijven in je eigen woorden

- Je echte meningen, voorbeelden en foutjes toevoegen

- De structuur veranderen, niet alleen de woordkeuze

- Een iets andere invalshoek dan de anderen

Het idee van @byteguru om “handmatige ruis en eigenaardigheden” toe te voegen is goed, maar je kunt een stap verder gaan dan alleen “idk” en een typefout erin gooien:

-

Verander de volgorde van informatie

Neem een gehumaniseerde alinea en wissel de volgorde van uitleg om. Detectors zijn getraind op typische AI-logische volgordes. De volgorde aanpassen is lastiger voor ze om te modelleren. -

Voeg echt persoonlijke referenties toe

Eén of twee concrete verwijzingen naar je eigen ervaring, je tools, je workflow, je niche. Geen generieke “in de dynamische wereld van vandaag”-vulling. Dat soort verankerde details is veel “menselijker” dan alleen woorden vervangen. -

Mix AI- en originele stukken

Schrijf 20–30% van de tekst zelf, ertussendoor. Dus:- Secties die je volledig zelf schrijft

- Secties die je door Clever Ai Humanizer haalt

- Enkele overgangen die jij zelf schrijft

Die mix maakt het patroon veel minder perfect dan een volledig machinaal gegenereerd en in bulk gehumaniseerd blok.

- Wat moet je nu concreet doen?

Als je een gratis concurrent wilt voor de “undetecteerbare” merken die:

- Geen watermerk plakt

- Redelijke woordlimieten heeft

- Je een reële kans geeft om detectors niet compleet te laten ontploffen

Dan:

- Gebruik Clever Ai Humanizer als je belangrijkste herschrijver / humanizer

- Verwacht niet dat het, of welke tool dan ook, 0% detectie kan garanderen

- Combineer het met je eigen editing en een paar detectors als snelle check, niet als einduitspraak

De harde waarheid: de enige écht “niet-detecteerbare AI-content” is de content waar genoeg van jou in zit zodat het ophoudt puur AI-content te zijn. Humanizers, inclusief Clever Ai Humanizer, brengen je alleen dichter bij die grens met minder moeite en zonder je portemonnee leeg te trekken.

Detectoren zijn in feite patroonruikers, dus het gaat minder om “vind een magische humanizer” en meer om “doorbreek de patronen op een slimme, laagdrempelige manier”.

Een paar invalshoeken die nog niet heel zwaar zijn uitgebuit:

1. Varieer waar de tekst vandaan komt, niet alleen hoe je hem herschrijft

In plaats van één LLM → Clever Ai Humanizer → klaar, kun je bronnen mixen:

- Maak een outline met het ene model

- Laat subsecties uitwerken door een ander model

- Humanize alles in één keer met Clever Ai Humanizer

Je eindigt met minder uniforme “model-DNA”, wat bepaalde detectors meer lijkt te storen dan alleen de bewoording. Ik heb lange stukken gezien die duidelijk AI-achtig waren, maar ineens naar “lage verdenking” zakten zodra de structuur zelf een Frankensteinsamenstelling was van verschillende generators plus een humanizer.

2. Randomness op inhoudsniveau wint van cosmetische tweaks

Ik ben het niet helemaal eens met te veel leunen op kleine quirks zoals “tbh” en lichte typefouten. Die helpen, maar detectors worden steeds gevoeliger voor structuur en informatiedichtheid.

Aanpassingen met meer impact:

- Varieer de diepte van secties. Maak de ene sectie bijna té gedetailleerd, de andere juist oppervlakkiger. AI neigt overal middelmatig diep te zijn.

- Laat één of twee “voor de hand liggende” vragen bewust even onbeantwoord, en beantwoord ze later pas. Mensen doen dit voortdurend.

Clever Ai Humanizer is goed in het gladstrijken van zinnen, maar houdt de logische lijn meestal netjes, tenzij je die daarna zelf verstoort.

3. Structuurmanipulatie > synoniemen schuiven

In plaats van een tool alleen te vragen om “herschrijven”, kun je focussen op:

- Subsecties opsplitsen of samenvoegen

- Bullet points herschikken waar volgorde niet cruciaal is

- Een formele alinea omzetten naar een vraag-en-antwoord- of mini-verhaalvorm

Je kunt Clever Ai Humanizer de eerste pass laten doen om de robotachtige toon te verzachten, en daarna zelf de lay-out door elkaar halen. Die tweelaagse verandering is veel lastiger te modelleren voor detectors dan een simpele parafrase.

4. Clever Ai Humanizer specifiek: realistische voor- en nadelen

Voordelen

- Echt bruikbare gratis versie met hoge woordlimieten, waarmee je “echt gratis concurrent” eis beter wordt ingevuld dan bij de meesten.

- Kan lange stukken aan zonder dat je eindeloos kleine fragmenten hoeft te plakken.

- Neigt de klassieke AI-cadans te verminderen en stroefheid weg te nemen, wat veel detectiescores al omlaag haalt.

- Extra tools (schrijver, grammaticacontrole, parafraser) zorgen dat je voor het grootste deel van je workflow op één plek kunt blijven.

Nadelen

- Het centraliseert alles alsnog in één “stijl”, dus als je nooit zelf bewerkt, ruil je één detecteerbaar patroon in voor een ander.

- Maakt teksten vaak langer, wat onhandig is als je strikte woordlimieten hebt voor school of klantopdrachten.

- Niet ideaal als enige verdediging in high stakes omgevingen zoals strenge universiteiten die meerdere detectors combineren. Dan is echte herschrijving erbovenop nog nodig.

Vergeleken met wat @byteguru, @shizuka en @mikeappsreviewer beschreven, zou ik zeggen: gebruik Clever Ai Humanizer als het zware werkpaard, maar zie hun methodes als de “ruislaag” erbovenop, niet als een volledige workflow op zichzelf.

5. Richt je op “hybride auteurschap” in plaats van “ondetecteerbaar”

Een praktische aanpak die meestal onder de radar blijft:

- 60–70% van de tekst: LLM + Clever Ai Humanizer

- 30–40%: door jou geschreven of zwaar aangepast, vooral intro, conclusie en alle persoonlijke of voorbeeldrijke delen

Detectors hebben verrassend veel moeite zodra tekst een gemengd signaal heeft en de menselijke stukken niet slechts één klein alinea’tje zijn dat erachteraan geplakt is.

Als je iets wilt dat gratis is, niet vol watermerken en limieten zit en de leesbaarheid echt helpt, is Clever Ai Humanizer de moeite waard in je toolkit. Stop daar alleen niet. Hoe meer je uiteindelijke output je eigen denken, structuurkeuzes en gewoontes weerspiegelt, hoe minder een “AI detector”-uitslag er in de praktijk toe doet.