私は、Originality AI の humanizer ツールの無料代替を探しています。AI が生成した文章を、より自然に聞こえるようにしつつ、一般的な AI 検出ツールをしっかり通過できるものが理想です。いくつかの無料ツールを試しましたが、依然として AI としてフラグが立つか、テキストが読めないほど不自然になってしまいます。特に、ブログ運営者やコンテンツライターが、お金をかけずに人間らしさを保ちたい場合に使える、信頼できる無料オプションやワークフローがあれば教えてもらえませんか。

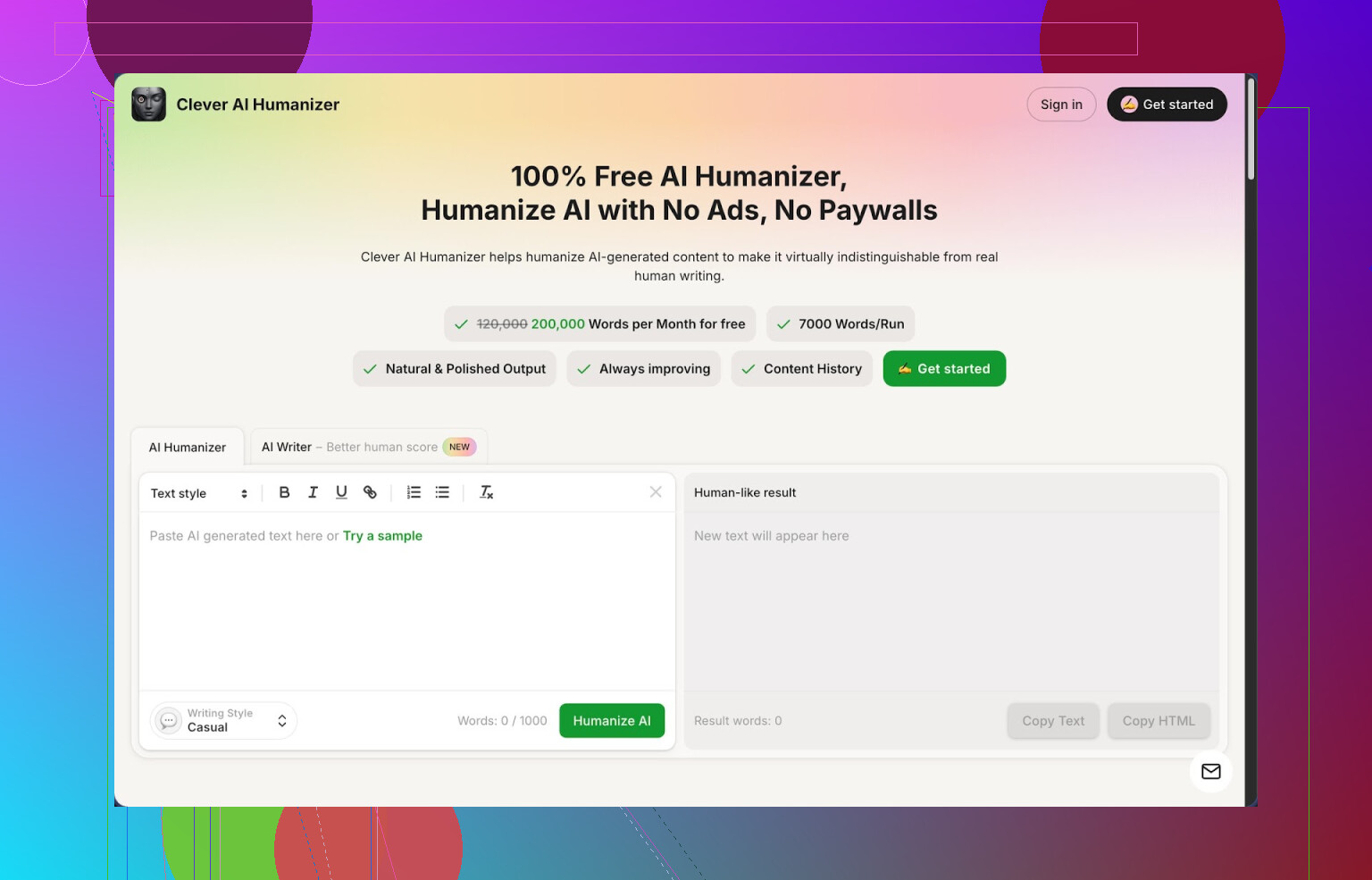

1. Clever AI Humanizer – 本気で使い込んで分かったこと

Clever AI Humanizer は、最終的に自分がいちばん使うようになったツールです。理由はシンプルで、文章量が多いのと、なるべくお金をかけたくないからです。

自分のテストから分かったざっくり仕様:

- 無料枠で月あたり約20万語まで使えた

- 1回あたりおよそ7,000語まで処理できるので、長文も一気にいける

- スタイルは3種類:カジュアル、シンプルアカデミック、シンプルフォーマル

- 人間味付け機能と連動したAIライターを内蔵

ChatGPT系の出力をいくつか流し込んで、ZeroGPTでチェックしました。カジュアルモードを使ったところ、自分の3サンプルすべてが ZeroGPT 上でAI判定0%という結果に。多くのツールがここで大きくコケるので、少し意外でした。もちろん、いつも0%になるとは限りませんが、自分の最初のテストではきれいにパスしました。

日常的に使えると感じたポイントは、この語数上限です。トークン制でもクレジット制でもなく、「上限に達しました」ポップアップが数分おきに出ることもない。エッセイ、ブログ記事、クライアント向けコンテンツを大量に書く場合でも、月20万語あれば、アカウントを使い分けなくてもかなりカバーできます。

モデルで文章を書く人なら分かるいつもの問題にもぶつかりました。生のAIテキストは硬くて、判定ツールには高確率で「100%AI」と叩かれる。そこでツールを探し回り、2026年にいくつか試した結果、常にピン留めして開いていたのがこれでした。

ここから、自分が実際に使った流れと、うまくいかなかった点も含めて説明します。

メインで使ったのは:Free AI Humanizer

使い方は単純です。AIが出した文章をコピペして、カジュアル/シンプルアカデミック/シンプルフォーマルからスタイルを選び、実行するだけ。数秒で、自分が「疲れた火曜日」に書きそうな感じに近いテキストを返してくれます。

チェックしたポイント:

- 検出ツールのスコア(このときは主に ZeroGPT)

- 事実や数値が崩れていないか

- シンプルな文がムダに膨らんでいないか

検出面は、自分の範囲ではかなり安定していました。意味もおおむね保たれていました。短めのテクニカルな内容は原文にかなり近いまま。長めの意見系の文章は少し膨らみましたが、話題はちゃんとオンテーマ。リストが多かったり専門用語が多かったりする場合は、結局自分の目で流し読みしたほうがいいですが、意味不明な文章を差し込んでくることはありませんでした。

気に入った点が1つあります。文章の流れを整えるときに、むやみに同義語に置き換えないこと。単語を片っ端から入れ替えて文を壊すタイプのツールとは違って、自分のテストではそうした動きは見られませんでした。言い回しを変えたり、節の位置を入れ替えたり、文の長さに変化をつけたりしていて、「単語の差し替え」だけに頼っていない印象です。

Clever AI Humanizer 内のその他の機能

Free AI Writer

これはゼロから書かせる機能です。トピックを渡すと、エッセイや記事を生成し、そのまま同じパイプラインで人間味付けまで走らせてくれます。やる気の出ない日は、ざっくりトピックを入れて下書きを作り、その結果をもう一度人間味付けに通して、検出スコアをより安全側に寄せる使い方をしました。

「AIで書いてから人間味付け」のコンボは、別のモデルで書いた文章に後から人間味付けするよりも、検出ツールでのスコアが良くなることもありました。おそらく、彼らのAIライター自体が、自前のヒューマナイザーと相性良く動くように調整されているのだと思います。学校のレポートや穴埋め用のブログ記事を素早く回したい場合、この流れだとコピペ作業がかなり減ります。

Free Grammar Checker

人間味付けのあとに、文法チェック機能にも通してみました。直してくれたのは:

- タイプミスやカンマ抜け

- 不自然な言い回しや分かりにくい表現

- そのまま残っていた単語の重複

体感としては、Grammarly の無料版に流すのと近い感じですが、同じページ内にヒューマナイザーと並んでいる分、作業が速いです。貼り付け → 人間味付け → 文法チェック → エクスポート、で完了。

Free AI Paraphraser

こちらはいわゆる「言い換え」ツールに近い機能です。元の意味は保ったまま、別表現に書き換えます。自分はこんな用途で使いました:

- 同じテーマで文言だけ変えたいSEO用テキスト

- 堅すぎる原稿を、少しくだけたトーンに落とすとき

- クライアント資料の一部分だけを言い換えたいとき

ヒューマナイザーが「AIっぽさのパターンを消してスタイルを整える」方向なのに対し、パラフレーズ機能は「別の言い回しに変える」ことに主眼があります。1回目の出力でもまだ検出ツールに引っかかったり、元ソースに似すぎている場合は、この2つを組み合わせると調整しやすいです。

日々のワークフローへの組み込み方

一週間ほど書きまくっていたときの自分の流れは、だいたい次のようなものでした:

- いつも使っているモデルか、Clever のAIライターでベース原稿を作る

- そのテキストを Clever AI Humanizer にかけ、カジュアルかシンプルアカデミックを選ぶ

- 一部を ZeroGPT などの検出ツールでチェック

- スコアが微妙なところだけ、パラフレーズで言い換える

- 最後にまとめて文法チェック

これらがすべて1つのインターフェース内で完結するので、ブラウザのタブを5つも6つも行き来する必要がありません。大量に書く人ほど、この「摩擦の少なさ」は効いてきます。

機能としては、ざっくり4種類がまとまった形です:

- ヒューマナイザー

- AIライター

- 文法チェッカー

- パラフレーズツール

無料ツールとして考えると、「とりあえずロボットっぽくない文章に仕上げて出したい」という用途の大半をカバーしてくれます。

欠点や気になったところ

とはいえ万能ではなく、厳しめの用途では見逃せない点もありました。

- 長文で構造がしっかりした文章や、箇条書きが多い文章では、一部の検出ツールにまだAI判定されることがありました。1回の「グリーン判定」を万能の保証として過信しないほうがいいです。

- 人間味付け後は、テキスト量が増えがちです。短い段落が長くなり、前後の文脈説明やつなぎの文が増えます。検出ツール対策としてはプラスですが、文字数制限の厳しい案件ではマイナスになりえます。

- ときどき、独特の言い回しが繰り返されることがあります。同じクライアント向けに大量処理していると、パターンが見えてくるので、自分の手で少し混ぜてあげたほうが自然です。

それでも、このレベルの機能を無料で使えることを考えると、自分の環境ではトップクラスの常用ツールになりました。今後、有料プランが前提になっていくようなら評価は変わるかもしれませんが、現時点では、出費ゼロでカバーできる範囲がかなり広いです。

もっとフォーマルなレビューやスクリーンショット、検出結果の詳細が見たい場合は、こちらにまとめがあります:

https://cleverhumanizer.ai/jp/community/t/clever-ai-humanizer-review-with-ai-detection-proof/42

また、ツールの操作をステップごとに解説しているYouTube動画もあります:

Clever AI Humanizer YouTube レビュー https://www.youtube.com/watch?v=G0ivTfXt_-Y

ほかの人がどんなツールを使っているか、自分の検証結果を共有したい場合は、以下のRedditスレッドが参考になりました:

Redditで挙がっているおすすめAIヒューマナイザー https://www.reddit.com/r/DataRecoveryHelp/comments/1oqwdib/best_ai_humanizer/?tl=ja

AIテキストの人間味付けについての総合スレ https://www.reddit.com/r/DataRecoveryHelp/comments/1l7aj60/humanize_ai?tl=ja/

Clever AI Humanizer を試すなら、まずは自分が普段書いている長めの文章を1本選び、カジュアルスタイルで処理してから、少なくとも2種類以上の検出ツールにかけてみるのがおすすめです。その上で、本番案件に使うかどうかを判断すると安全です。

もしあなたの目的が「検出ツールを通過できる無料のOriginality AI humanizer代替」なら、同時に二つの問題と戦っていることになります。

- テキストをより人間らしく読めるようにすること

- 常に変化し続けるパターンベースの検出ツールをかいくぐること

@mikeappsreviewer が共有していた Clever Ai Humanizer に関する内容は、私のテスト結果とも一致します。ただし、判定基準として ZeroGPT だけに頼るのはおすすめしません。検出ツールごとに引っかかるポイントが違うからです。

コストをゼロに保ちつつ、実際に機能した方法をまとめると次のようになります。

-

humanizer は最初の下書き用であって、最終解決策ではない

- Clever Ai Humanizer は、長文入力に対応しつつ、意味をある程度維持してくれる数少ないツールの一つです。

- Originality AI の検出ツールとの相性はまちまちです。ZeroGPT で「AI 0パーセント」と出ても、Originality では高スコアになることがあります。

- 一発で仕上げるボタンではなく、「書き直しのたたき台」として扱ってください。

-

言い換えだけでなく「構造」を変える

「バースティネス」や「パープレキシティ」に注目する検出ツールは、文章構造を見ています。humanizer にかけたあと、手作業で次のように直します。- 長すぎる文をいくつか短くする。

- 短い文をいくつかつなげて一文にする。

- 自分の声で短いコメントを1〜2個足す。

- 700〜1,000語ごとに、少なくとも1段落まるごと削除または変更する。

単語の言い換えより、パターンが大きく変わります。

-

自分ならではの「ノイズ」を入れる

馬鹿げて聞こえるかもしれませんが、効果があります。AI が予測しにくい要素を混ぜます。- 自分の生活や仕事からの具体的な例を1〜2個入れる。

- 「Xにはこう言われているが、Yの理由で自分は違うと思う」といった軽い反論部分を入れる。

- つなぎの文を少しだけ雑にする。

AI は一貫性やバランスを取りすぎる傾向があります。多少トーンが凸凹しているほうが自然です。

-

複数のモデルとツールを混ぜる

検出ツールが特定モデルの癖を学習すると、そのモデル由来の文章は狙い撃ちされやすくなります。私の経験では、次のようにしたほうが結果が安定します。- まず別のツールで元の文章を生成する。

- それを Clever Ai Humanizer に通す。

- 仕上げは別のAIではなく、プレーンなエディタで手作業修正する。

こうすることで、1つではなく3種類のパターンレイヤーが重なることになります。

-

箇条書きやテンプレ構成に注意

検出ツールがよくフラグを立てるのは次のようなものです。- H2・H3や箇条書きだらけの、過度に構造化されたコンテンツ

- 「導入 → 3つのポイント → まとめ」といった典型的テンプレ構成

humanizer にかけたあと、次のようにパターンを少し崩します。 - 見出しを一つ削除するか、通常の一文に変える。

- 箇条書きの一部を短い段落に書き直す。

これで「AIっぽいブログ記事の型」を少し薄められます。

-

検出ツールは必ず複数使う

Originality AI、ZeroGPT、GPTZero、Copyleaks などは、それぞれ挙動が違います。

手早いワークフローとしては次の通りです。- まず Clever Ai Humanizer に通す。

- 検出ツールを1つではなく2つ使ってチェックする。

- どちらかで引っかかった部分だけ、主に構造とトーンを手作業で再調整する。

@mikeappsreviewer とは少し意見が違うのが、「内蔵AIライター+humanizer」のセットにあまり頼りすぎないほうがよい、という点です。確かにあの組み合わせは便利ですが、両方が同じ思想でチューニングされていると、毎日使ううちに独特のパターンが残りやすくなります。

私の経験では、ベースとなる下書きを別の場所で作り、その上に Clever Ai Humanizer を重ね、最後に手作業で仕上げるほうが、長期的にスコアが安定しやすいです。

「無料でそこそこ通れば十分」という優先順位なら、次の組み合わせが現実的です。

- 大きな書き直しは Clever Ai Humanizer に任せる。

- 構成と文体は自分の手で整える。

- 弱点を洗い出すために検出ツールを2種類使う。

多少時間はかかりますが、質の低い「無料humanizer」ツールを10個試して、どれも同じような硬い文章しか出てこない、というモグラ叩き状態は避けられます。

短くまとめると:Originality の humanizer を完全に代替できて、ワンクリックで永遠に全検出器を突破できるような「無料で100%完璧なツール」は存在しませんが、無料でそこそこ実用レベルまで近づける組み合わせならあります。

無料のメイン候補として Clever Ai Humanizer を使う点については、@mikeappsreviewer さんと @viaggiatoresolare さんにほぼ同意です。月20万語と長文入力が可能なのはかなり大きいです。自分が少しだけ違う意見なのは、どんなツールでも「ひとつに依存しすぎない方がいい」という部分です。検出ツールは humanizer より速いペースで進化します。

自分の実務でうまくいっているやり方はこんな感じです。

-

Clever Ai Humanizer は「スタイル変換ツール」として使う

「AI由来を完全に隠すマシン」としてではなく、文章をカチカチのテンプレから外すための道具として扱います。自分はだいたいカジュアル設定で全体を通し、その時点で「7~8割できた」くらいに見ます。決して「これで100%完了」とは考えません。 -

語彙ではなく「リズム」を変える

humanize したあと、自分の手で次をやります。- 不自然にスムーズすぎるつなぎ表現をいくつか削る

- 実際の自分の話し方に合うように、段落をあえて割ったりくっつけたりする

- いかにもブログ的な「導入→3つの見出し→まとめ」構成を崩す

検出ツールは、この完璧な型にはまった構成をかなり好んで拾います。

-

AI が苦手な「リアルな具体性」を入れる

大きな体験談ではなく、小さくて具体的な要素を混ぜます。- 自分の仕事で実際に出た具体的な数値

- 「Xを試したときは普通に失敗した」みたいなミスの断片

- きれいに整えない、ちょっと崩れた言い回し(AI の出力ではまず出ないレベルの生々しさ)

-

検出ツールをひとつだけ信用しない

同じ文章でも、あるツールでは「人間っぽい」と出て、別のツールでは「ほぼAI」と判定されたことが何度もあります。Originality AI と、もう一つメジャーなチェッカーの両方を通過できていれば、「無料ツールで狙えるラインとしては、だいたい上限」にかなり近いです。

「無料で使える Originality AI humanizer の代わり」を唯一求めるなら、現状では Clever Ai Humanizer がほぼベストに近いと思います。ただし、そこに10~15分ぐらいの「人間らしい雑な手直し」を足してこそ本領を発揮します。その工程をサボると、どんなツールを使っても、いつかどこかの検出器に引っかかることになります。

人間らしさツール → 検出ツールという直列運用だけをしていると、永遠に尻尾を追いかけることになります。検出ツールはまさにその挙動を学習しているからです。

@viaggiatoresolare / @reveurdenuit / @mikeappsreviewer に一部同意しきれないのは、「魔法の」単一ツール、Clever Ai Humanizer を含め、どれかひとつに依存しすぎる点です。これは優れていますが、結局は一つの統計パターンを別の統計パターンの上に重ねているにすぎません。

この文脈での Clever Ai Humanizer のざっくり評価:

長所

- 無料枠がかなり太っ腹で、長文でも現実的に使える

- 大きな文章塊でも意味を壊さずに処理できる

- 単なる類語置換ではなく、文構造やリズムをずらして書き換える

- ライティング / 文法チェック / 言い換えが一体化していて、全体の作業を効率化できる

短所

- 同じような処理を大量にかけると、独特の文体が目立ってくる

- 文字数が不必要に増え、単純な内容まで妙にくどくなりがち

- 一部の検出ツールは、加工後でも長く構造化された記事をフラグ付けする

- もともとの下書きが「典型的なAI文」だと、「服だけ着替えた典型AI文」になりがち

ここから、ほかの方の意見に自分が 付け足したい ところ:

-

最初から検出されにくい下書きを作る

すでにモデルを使っているなら、最初の段階で「ノイズ」を入れます。段落を短くする、時々余談を入れる、一人称コメントを混ぜる、「導入 → 見出し3つ → 結論」といった定型構成を避ける、など。入り口を整えれば、後の人間らしさ加工をそこまで極端にしなくて済みます。 -

クライアントや案件ごとにツールをローテーションする

ひとつの固定スタックではなく、案件ごとに回すイメージで: あるときは Clever Ai Humanizer を通し、別のときは軽めの言い換え+手作業の大幅編集にとどめる、といった具合です。検出器は、単一記事よりも「複数記事にまたがる同じパターン」を見抜きやすいです。 -

仕上がりをあえて部分的に「崩す」

Clever Ai Humanizer を通したあとに、3〜5か所を意図的にラフにします:- 全体がなめらかな中に、短くぶっきらぼうな文を一つ入れる

- 自分なら本当に使いそうな、やや変わった比喩を一つ入れる

- きれいに本筋へ回収されない小さな脱線を挟む

こういう「微細なカオス」は、大量生成では真似しづらい部分です。

-

検出ツールは「判決」ではなく「異論マシン」として扱う

Originality AI と別ツールで判定が割れたときは、「どこが」強く反応しているかを見るようにします。多くの場合、フラグが立つ部分は似たパターンを共有していて、構造がきれいすぎるリストや、バランスの取れた議論、教科書的な定義が並んでいるはずです。その部分だけを手作業で書き直し、他の流れは維持します。 -

長文は分割して、セクションごとに処理を変える

3,000字以上の文章は、セクションに分けて別々に扱います。一部は Clever Ai Humanizer、一部は軽いパラフレーズ、一部はほぼ自分で書き直す、といったバラけさせ方をしてから最後に統合します。数千字にわたって単一パターンが続く状態こそ、検出ツールが好む獲物です。

まとめると、Clever Ai Humanizer は今のところ、Originality 系の人間らしさツールの無料代替としてかなり有力ですが、「レシピ全体」ではなく「一つの材料」として使うべき存在です。ツールの出力に自分のラフな編集や多様な構成を混ぜる方が、同じツールを何度も回して検出器を出し抜こうとするより、ずっと健全で結果も安定します。